为OpenClaw配置模型降级(故障转移)

本文作者:猫猫摸大鱼 原文地址:https://iloli.love/archives/1772467309102

1. 前言

本文隶属于 OpenClaw 龙虾系列教程文章,建议按顺序阅读,可以访问OpenClaw龙虾系列教程文章目录 https://iloli.love/archives/1766849996690 查看其它文章

本文基于 OpenClaw 2026.3.1 官方一键脚本直装版本

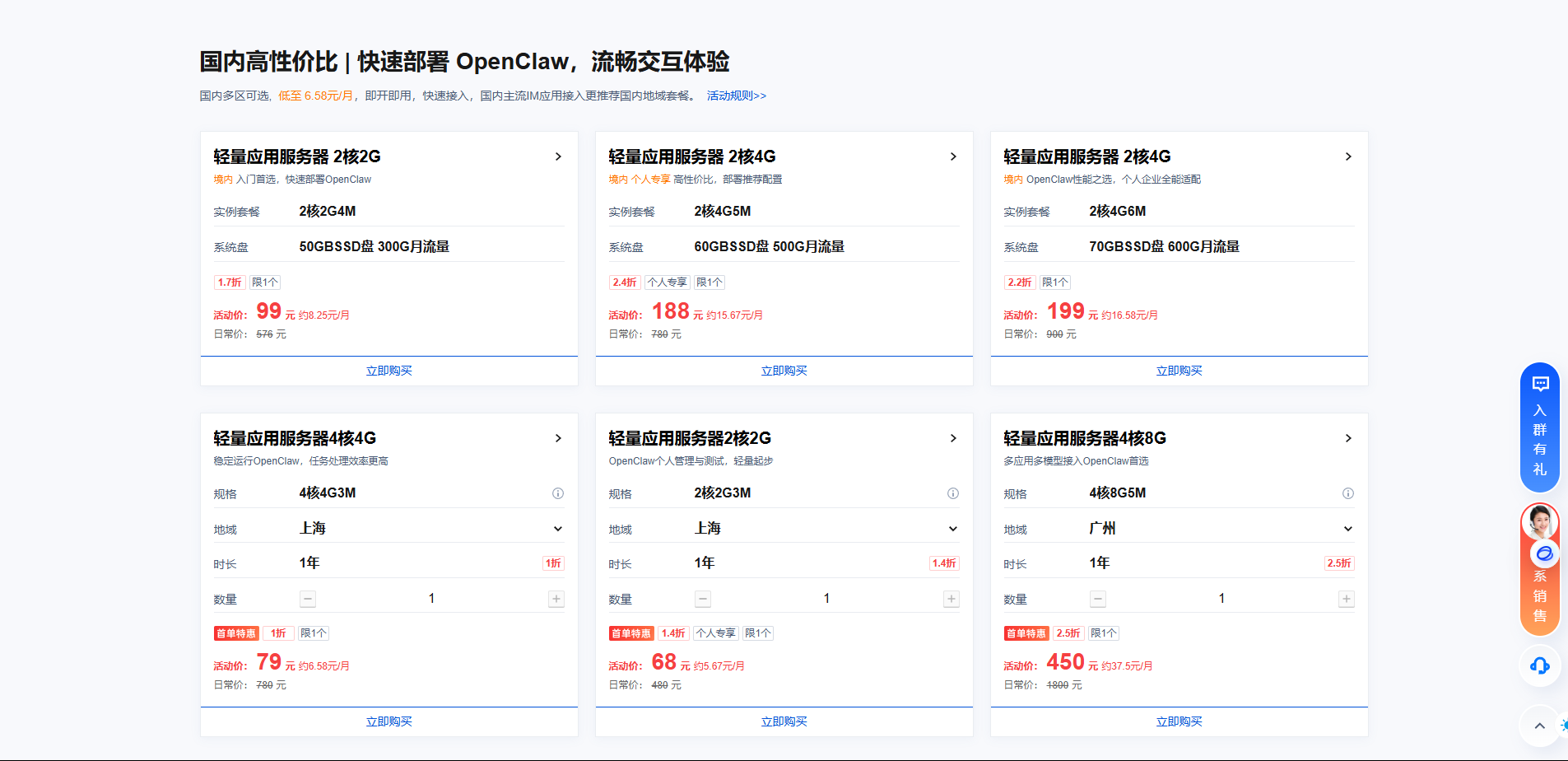

本系列教程全程使用腾讯云轻量应用服务器,可以参加腾讯云OpenClaw专属活动进行购买,新客68/年起,老客99/年起

活动链接 https://cloud.tencent.com/act/pro/lighthouse-moltbot (无AFF) http://to.iloli.love/openclaw (有AFF)

就算不买也强烈推荐使用有 快照 功能的厂商的服务器进行搭建,并且一定要经常打快照,不要问为什么,血的教训,血的教训,血的教训

2. 场景

刚刚由于模型限频了,出现了这样的情况,于是我就在想,能不能有降级机制,模型不可用自动回落到其它模型呢

于是翻阅了一会文档,发现OpenClaw本身就有模型降级机制,那么接下来我们就开始配置

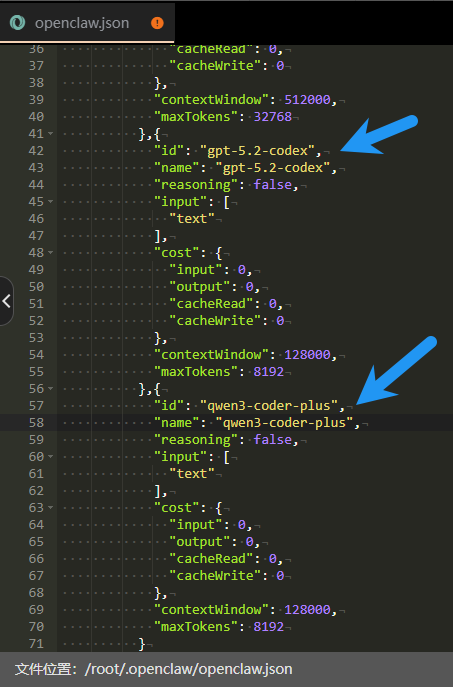

(本文中我再接入两个 gpt-5.2-codex 和 qwen3-coder-plus 作为降级模型)

3. 开始配置

3.1 手动配置 (比较麻烦,如果不小心多或者少了字符可能导致配置文件格式错误)

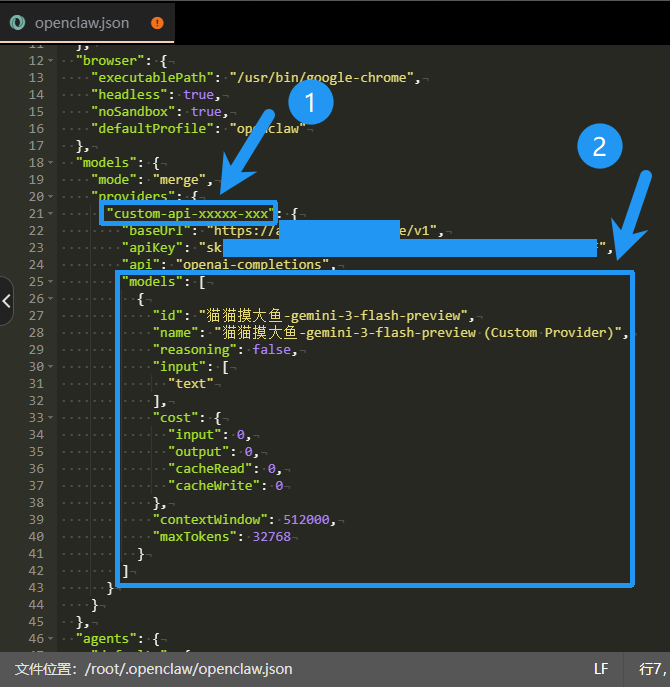

打开 /root/.openclaw/openclaw.json

首先,为我们自建的大模型API多接入几个模型

图中 1 所指的框框,是我们的大模型API的渠道名称,如果你是跟着我的教程走的话,这里应该是 custom-api-xxxxx-xxx ,我们下文也都以这个为例子;图中 2 所指的框框,就是我们这个自定义渠道已经接入的模型配置

那么现在就开始多配置几个模型

复制如下代码(一定要带着缩进复制)

,{

"id": "gpt-5.2-codex",

"name": "gpt-5.2-codex",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 128000,

"maxTokens": 8192

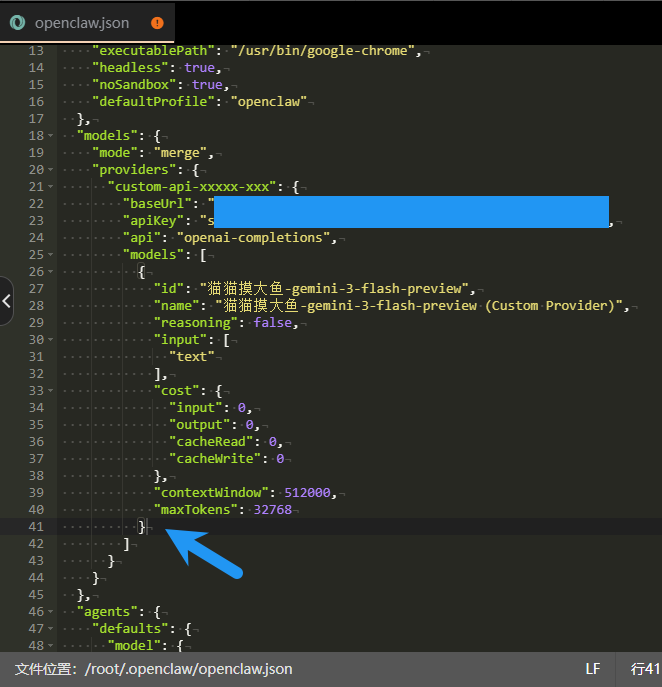

}然后把光标点到 maxTokens 下面的那个 } 后面

直接粘贴两个,然后挨个修改 ID 和 Name ,ID 一定要是模型名称,Name 随意,至于其他参数可按需修改

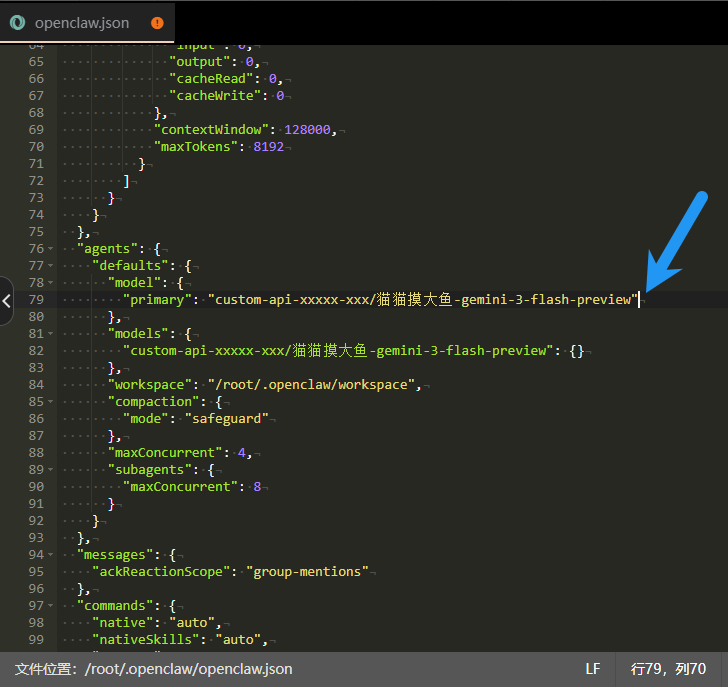

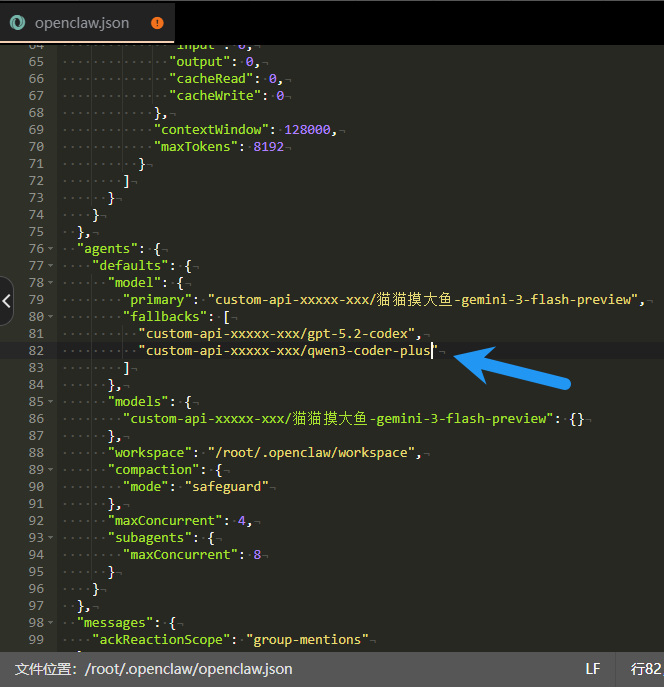

接下来,为我们的主agent配置降级模型

复制如下代码(一定要带着缩进复制)

,

"fallbacks": [

"custom-api-xxxxx-xxx/gpt-5.2-codex",

"custom-api-xxxxx-xxx/gpt-5.2-codex"

]找到 agents 配置,将光标移动到 primary 行的 " 后面,直接粘贴

将 custom-api-xxxxx-xxx 修改为你实际的渠道名称,然后修改模型名称

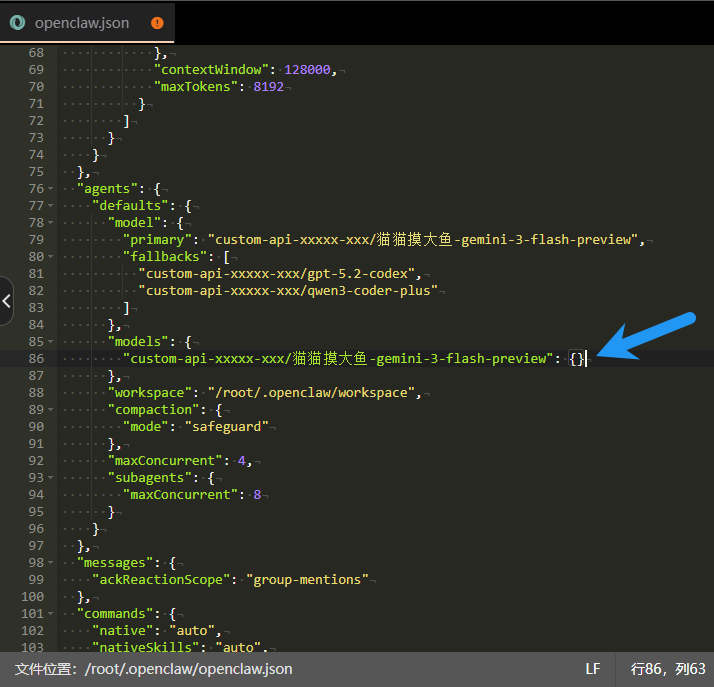

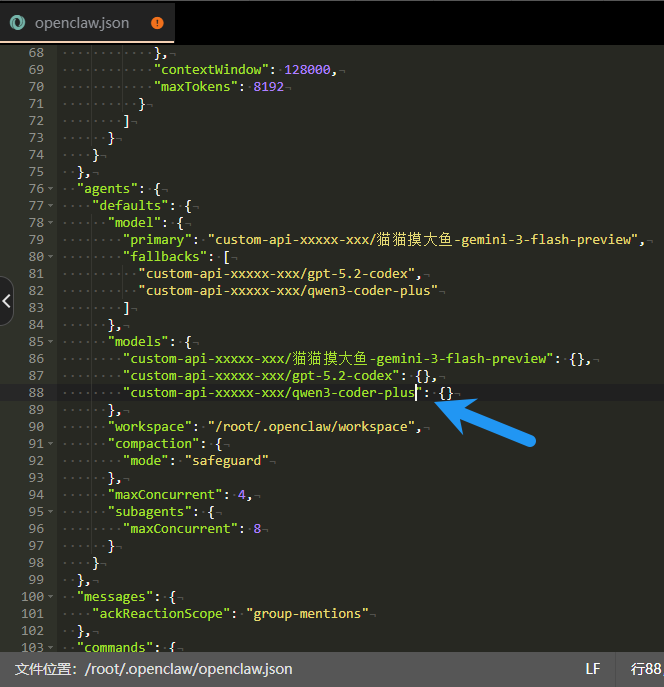

继续复制如下代码(一定要带着缩进复制)

,

"custom-api-xxxxx-xxx/gpt-5.2-codex": {},

"custom-api-xxxxx-xxx/gpt-5.2-codex": {}将光标放到如图中的 {} 后面,直接粘贴

将 custom-api-xxxxx-xxx 修改为你实际的渠道名称,然后修改模型名称

修改完成,保存文件,然后运行以下命令重启 openclaw 网关

openclaw gateway restart3.2 直接让 Bot 帮你配置 (简单,但是AI可能会出错)

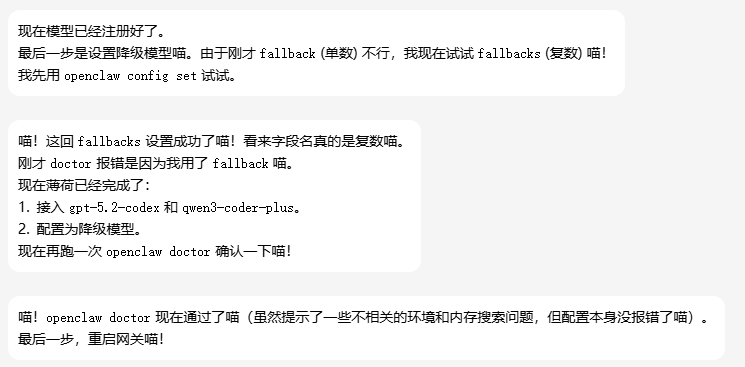

直接给Bot发消息: 将 gpt-5.2-codex 和 qwen3-coder-plus 作为当前渠道内的模型接入,复用现有模型的参数,配置进模型列表,并依次作为降级模型;接入完成后,回复我具体进行了哪些修改,并使用 openclaw doctor 测试是否存在未知问题,如果有则告诉我,并依照提示解决问题,没有问题后,再重启网关;全部完成后向我报告

可以看到,bot自己开始了配置,虽然中间出现了错误,但因为我们优秀的提示词最终还是改正了;至于最后应该是因为重启网关了,所以没有后续的消息

(该说不说,确实比手动配置爽)